隨著人工智能技術的飛速發展,今年兩會期間,AI時代下的法律風險與互聯網安全服務成為代表委員們熱議的焦點。在數字化轉型浪潮中,如何平衡技術創新與法律規制,構建安全的網絡環境,已成為當務之急。

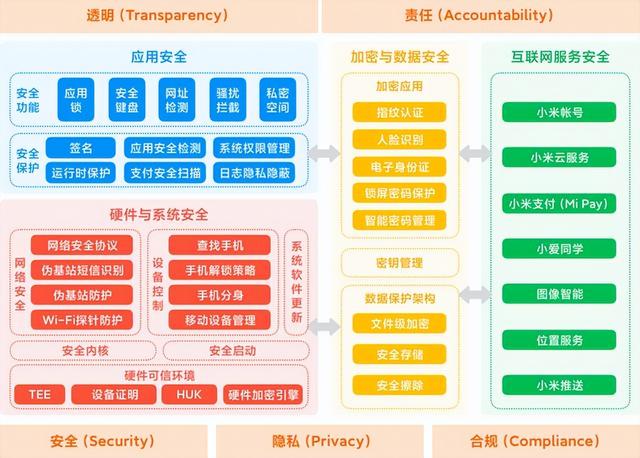

當前,人工智能在提升生產效率和生活便利的同時,也帶來了數據隱私泄露、算法歧視、深度偽造等新型法律風險。例如,未經授權的個人數據收集可能侵犯公民隱私權,而算法決策的不透明性可能導致就業、信貸等領域的不公平現象。AI生成的虛假信息對社會信任體系構成嚴峻挑戰。

針對這些風險,兩會代表提出多項建議:應加快完善人工智能專門立法,明確數據所有權、算法問責機制和人工智能倫理標準;建立跨部門協同監管體系,實現對AI應用的全生命周期管理;推動企業建立內部合規審查制度,將安全理念融入產品研發全過程。

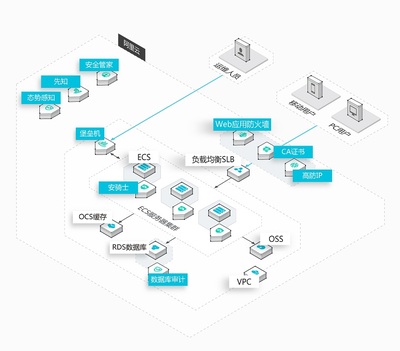

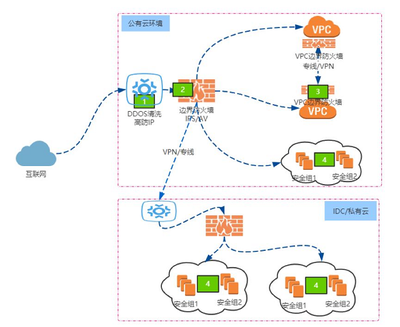

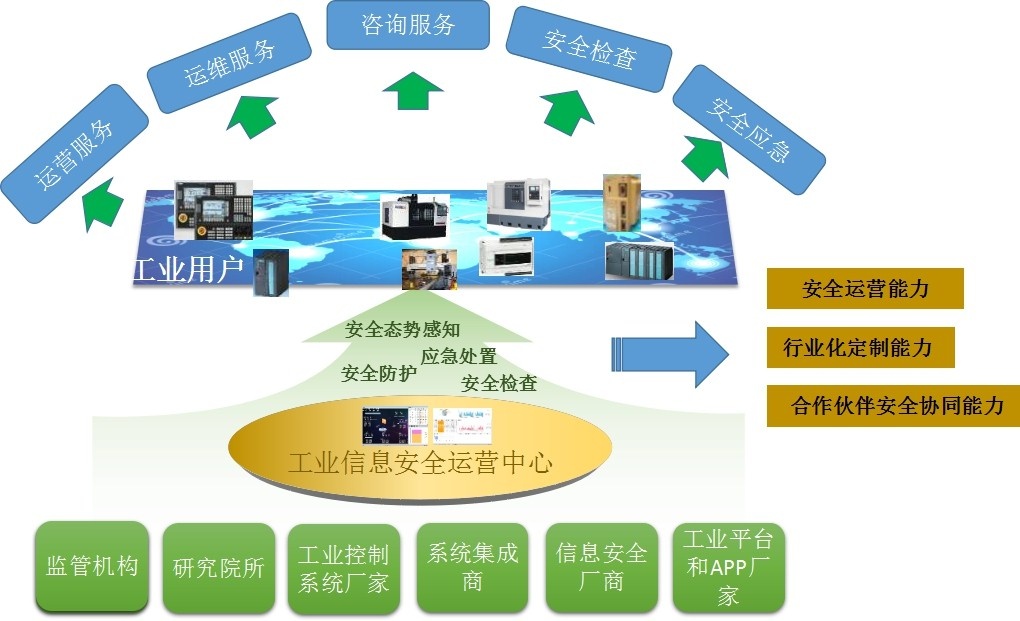

在互聯網安全服務方面,專家呼吁加強網絡安全基礎設施建設,提升關鍵信息系統的防護能力。同時,應大力發展安全即服務(Security as a Service)模式,為中小企業提供專業化的安全解決方案。通過產學研合作培養復合型網絡安全人才,也是保障數字中國建設的重要環節。

值得注意的是,在應對AI風險的過程中,需要避免過度規制抑制創新。理想的做法是采取"監管沙盒"等柔性監管方式,在保障安全的同時為技術發展留出適當空間。

隨著《網絡安全法》《數據安全法》等法律法規的深入實施,以及企業對合規經營的日益重視,我國有望構建起與技術發展相適應的法律框架和安全管理體系,為數字經濟發展筑牢安全屏障。